Q: Apa faktor hardware terpenting untuk menjalankan LLM secara lokal?

A:

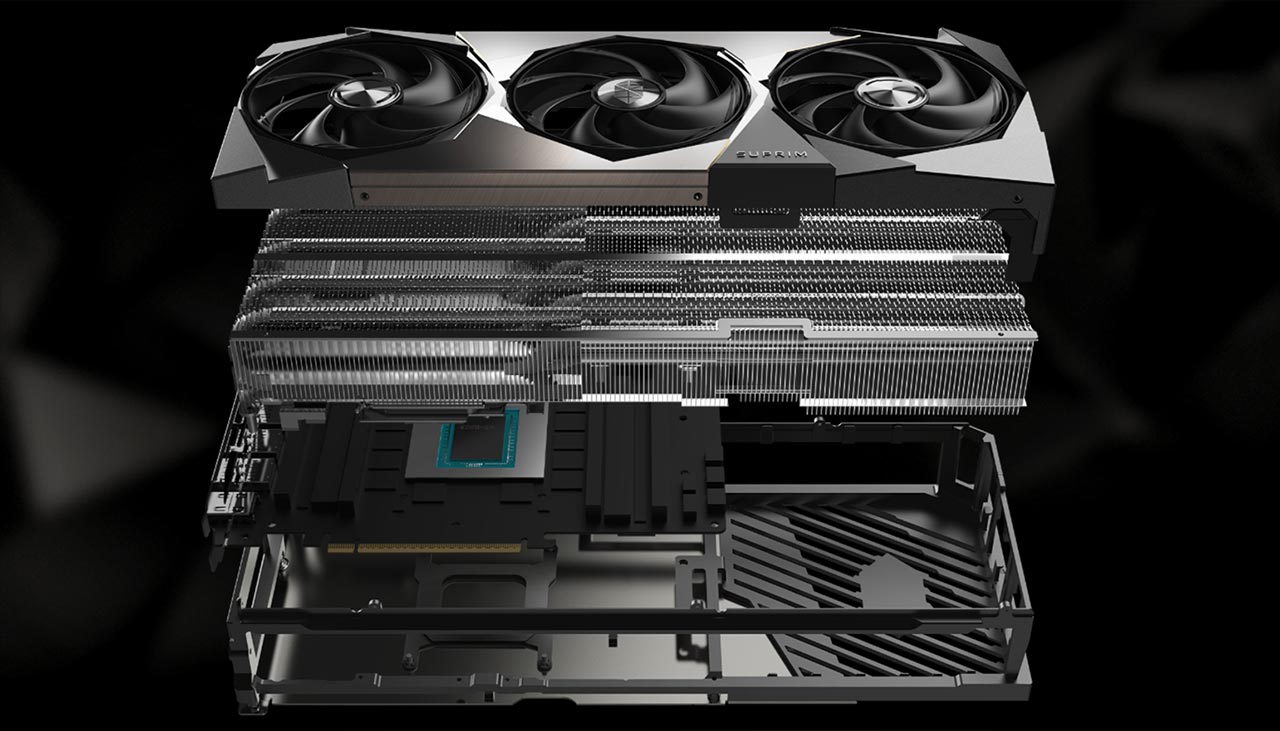

VRAM GPU dan kemampuan komputasi AI menjadi faktor utama untuk performa AI lokal, diikuti oleh RAM sistem dan CPU modern. Kapasitas VRAM yang cukup menentukan ukuran model maksimal yang bisa dijalankan secara efisien di PC Anda.

Q: GPU mana yang terbaik untuk menjalankan model AI kompleks (seperti LLaMA, GPT, Mistral, dll.) dan menangani workload AI tingkat lanjut?

A:

GeForce RTX 5090 dengan 32 GB VRAM adalah salah satu GPU terbaik yang tersedia saat ini untuk menjalankan model AI dan menangani workload AI tingkat lanjut, berkat Tensor Core generasi terbaru. Jika kamu ingin opsi dengan value terbaik, pertimbangkan GeForce RTX 5070 Ti sebagai pilihan yang lebih efisien.

Q: Bagaimana Tensor Core meningkatkan performa AI pada GPU GeForce RTX?

A:

Tensor Core mempercepat workload AI dengan melakukan perkalian matriks menggunakan aritmetika presisi campuran (seperti FP16 atau FP8), sehingga meningkatkan performa secara signifikan tanpa banyak mengorbankan akurasi. Unit perangkat keras khusus ini mampu mengeksekusi operasi tersebut hingga 30x lebih cepat dibandingkan core GPU tradisional.

Q: Berapa banyak VRAM yang dibutuhkan untuk berbagai ukuran model AI?

+

A:

Meskipun kebutuhan VRAM berbeda-beda tergantung pada presisi yang digunakan dan modelnya, secara umum model 7B membutuhkan sekitar 8GB VRAM atau lebih, model 13B memerlukan 16GB VRAM atau lebih, dan model 30B membutuhkan antara 24 hingga 30GB VRAM. Untuk model yang lebih besar, kebutuhan VRAM bisa bahkan lebih tinggi lagi.

Q: Apakah NVIDIA atau Radeon lebih baik untuk menjalankan workload AI?

+

A:

Secara umum, NVIDIA lebih unggul untuk workload AI berkat dukungan yang luas, library yang dioptimalkan, ekosistem perangkat lunak yang lebih kaya, serta GPU yang lebih bertenaga dengan kapasitas VRAM besar.

Q: Seberapa berat menjalankan AI workloads atau menjalankan AI lokal di hardware saya, dan apakah itu akan merusak komponen?

+

A:

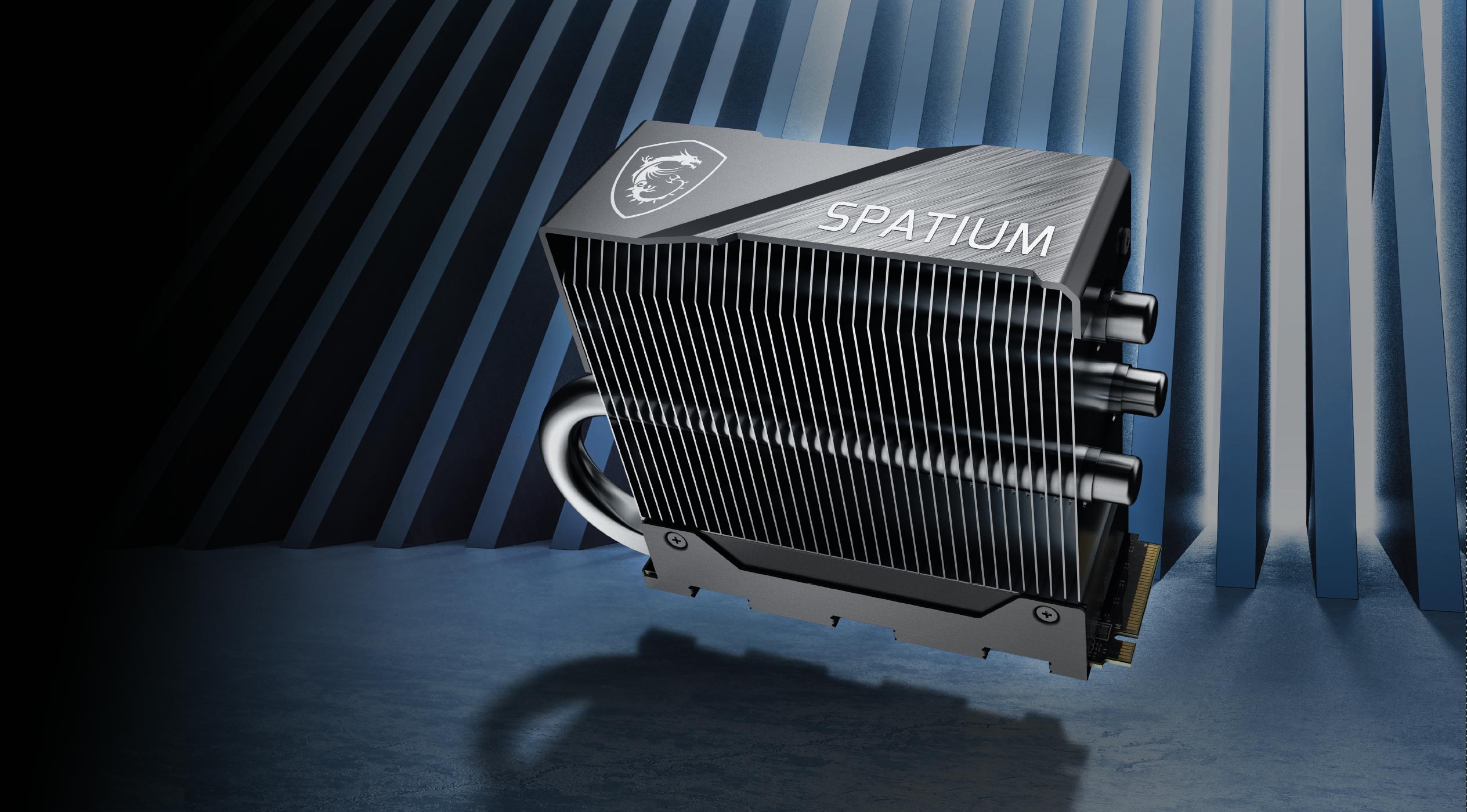

Menjalankan LLM (Large Language Models) memberikan beban yang mirip dengan gaming atau rendering, dan tidak akan merusak hardware selama sistem pendingin memadai. Beban berat sesekali aman untuk komponen modern, selama solusi pendinginan mampu mengatasi panas dengan efektif.

Q: Apa Spesifikasi minimum PC yang dibutuhkan untuk menujalankan LLM secara lokal?

+

A:

Disarankan memiliki VRAM 8-16GB, RAM 32GB, dan CPU modern 6-core. Semakin besar RAM dan VRAM, semakin besar dan kompleks model yang bisa dijalankan, sekaligus memungkinkan multitasking yang lebih lancar.

Q: Apakah lebih baik menggunakan beberapa GPU kelas bawah atau satu GPU kelas atas?

+

A:

Satu GPU kelas atas lebih sederhana dan menawarkan kompatibilitas jauh lebih baik dengan berbagai aplikasi.

Namun, setup multi-GPU bisa lebih hemat biaya, tapi pastikan performa beban kerja Anda benar-benar bisa meningkat dengan baik menggunakan beberapa GPU sebelum memilih opsi ini.

Q: Seberapa penting CPU dibanding GPU untuk performa AI?

+

A:

GPU jauh lebih berpengaruh untuk kecepatan inference dan pemrosesan AI di game, aplikasi kreatif, dll.

CPU hanya berperan jika Anda menjalankan model yang lebih besar dari VRAM Anda atau menggunakan fitur khusus CPU di beberapa aplikasi.

Q: Seberapa besar peningkatan performa yang diberikan DLSS dengan GPU GeForce RTX?

+

A:

DLSS pada GPU GeForce RTX dapat meningkatkan performa gaming hingga 2–4x dengan cara upscaling gambar beresolusi lebih rendah dan membuat frame baru menggunakan AI – menghasilkan frame rate lebih tinggi dan kualitas gambar lebih baik.

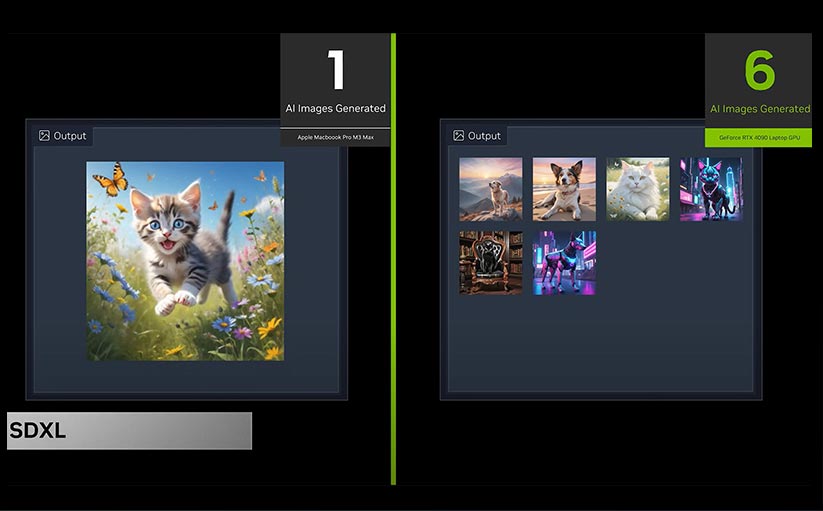

Q: Bagaimana perbandingan GPU GeForce RTX dengan chip Apple M‑series untuk tugas pemrosesan AI lokal?

+

A:

GPU GeForce RTX unggul dalam performa AI mentah, skalabilitas, dan dukungan ekosistem, sehingga menjadi pilihan utama untuk tugas AI lokal yang canggih. Sementara itu, chip Apple M‑series, meski efisien dan terintegrasi dengan baik dalam workflow Mac, lebih cocok untuk aplikasi AI ringan atau spesifik platform.